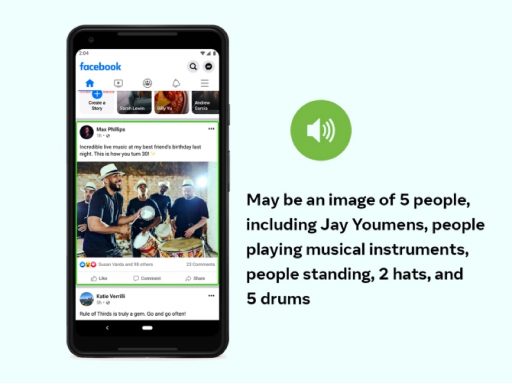

O Facebook e o Instagram estão utilizando inteligência artificial para melhorar a descrição de fotos para pessoas cegas ou com deficiência visual.Reconhecendo que muitas fotos são postadas sem texto alternativo, em 2016, a companhia introduziu uma nova tecnologia chamada Texto Alternativo Automático (AAT, na sigla em inglês).

O AAT — que foi reconhecido em 2018 com o prêmio Helen Keller Achievement da American Foundation for the Blind — utiliza reconhecimento de objetos para gerar descrições de fotos sob demanda, para que pessoas cegas ou com deficiência visual possam aproveitar mais plenamente seu Feed de Notícias.

A nova versão do AAT representa vários avanços tecnológicos que aprimoram a experiência em fotos dos usuários. Em primeiro lugar, o Facebook afirma que expandiu em mais de 10 vezes o número de objetos que o AAT pode detectar e identificar de forma confiável em uma foto, o que significa menos fotos sem uma descrição.

As descrições também são mais detalhadas, com a capacidade de identificar atividades, pontos de referência, tipos de animais e assim por diante — por exemplo: “Pode ser uma selfie de 2 pessoas, ao ar livre, na Torre de Pisa”.

Foto: Divulgação/Facebook

Todos os dias, os usuários do Facebook e Instagram compartilham bilhões de fotos. A onipresença de câmeras acessíveis em telefones celulares, conexões sem fio rápidas e mídias sociais como Instagram e Facebook tornaram mais fácil capturar e compartilhar fotografias, sendo uma das formas mais populares para se comunicar — inclusive para pessoas cegas e com deficiência visual.

“Embora desejemos que todos que publiquem uma foto incluam uma descrição em texto alternativo, reconhecemos que isso geralmente não acontece. Construímos o AAT para preencher essa lacuna, e o impacto que isso tem sobre aqueles que precisam é incomensurável. A IA promete avanços extraordinários e estamos entusiasmados com a oportunidade de levar esses avanços às comunidades que, muitas vezes, são mal atendidas”, afirma o Facebook.

Quando as pessoas navegam por seu Feed de Notícias no Facebook, elas encontram diversos tipos de conteúdo — artigos, comentários de amigos, convites para eventos e, claro, fotos. A maioria das pessoas consegue ver instantaneamente o que está nessas imagens, seja o registro de seu novo neto, um barco em um rio ou a imagem granulada de uma banda no palco.

Mas muitos usuários com deficiência visual também podem experienciar essas imagens, desde que sejam marcadas devidamente com texto alternativo (ou “texto alt.”). Um leitor de tela pode descrever o conteúdo dessas imagens usando uma voz sintética e permitir que as pessoas com deficiência visual entendam as imagens em seu Feed do Facebook.

Para a versão mais atualizada do AAT, o Facebook maximizou um modelo treinado em dados parcialmente supervisionados na forma de bilhões de imagens públicas do Instagram e suas hashtags. Para fazer com que os modelos funcionem melhor para todos, a companhia realizou ajustes para que os dados se tornassem amostras a partir de imagens em todas as geografias, e usando traduções de hashtags em muitos idiomas.

A empresa também avaliou seus conceitos sobre gênero, tom de pele e idade. Os modelos resultantes são mais precisos, além de cultural e demograficamente inclusivos — por exemplo, eles podem identificar casamentos em todo o mundo com base (em parte) em trajes tradicionais, em vez de rotular apenas fotos com vestidos de noiva brancos.

Em tempo, o Facebook anunciou recentemente mudanças na exibição das Páginas, saiba mais clicando aqui.